Alternative à Kubernetes — Conteneurs simplifiés

Alternative à Kubernetes

LayerOps vs Kubernetes

Kubernetes est puissant, mais il s'accompagne d'une complexité considérable. LayerOps vous offre les mêmes capacités de production — sans la charge opérationnelle.

Le voir en Action

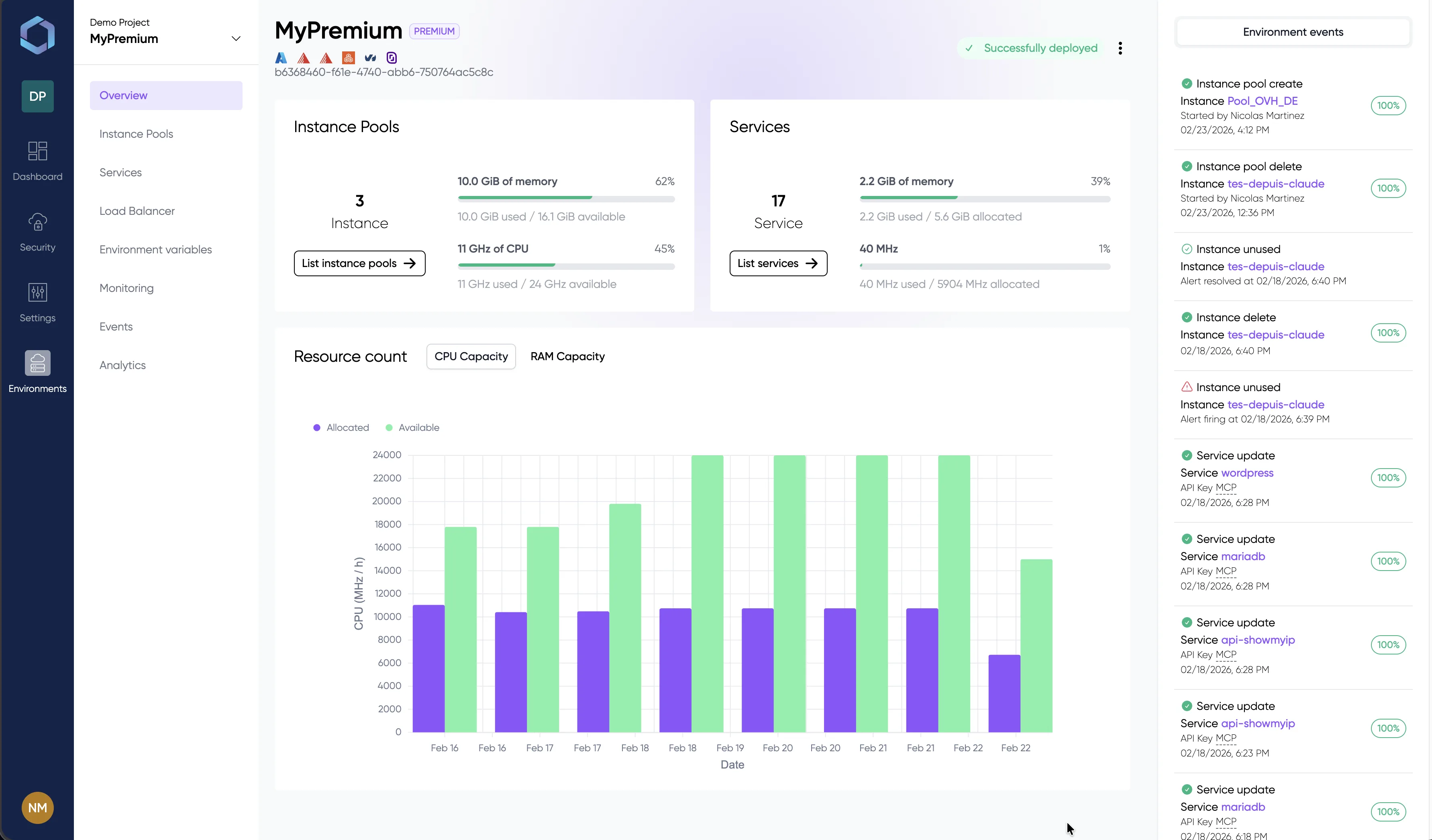

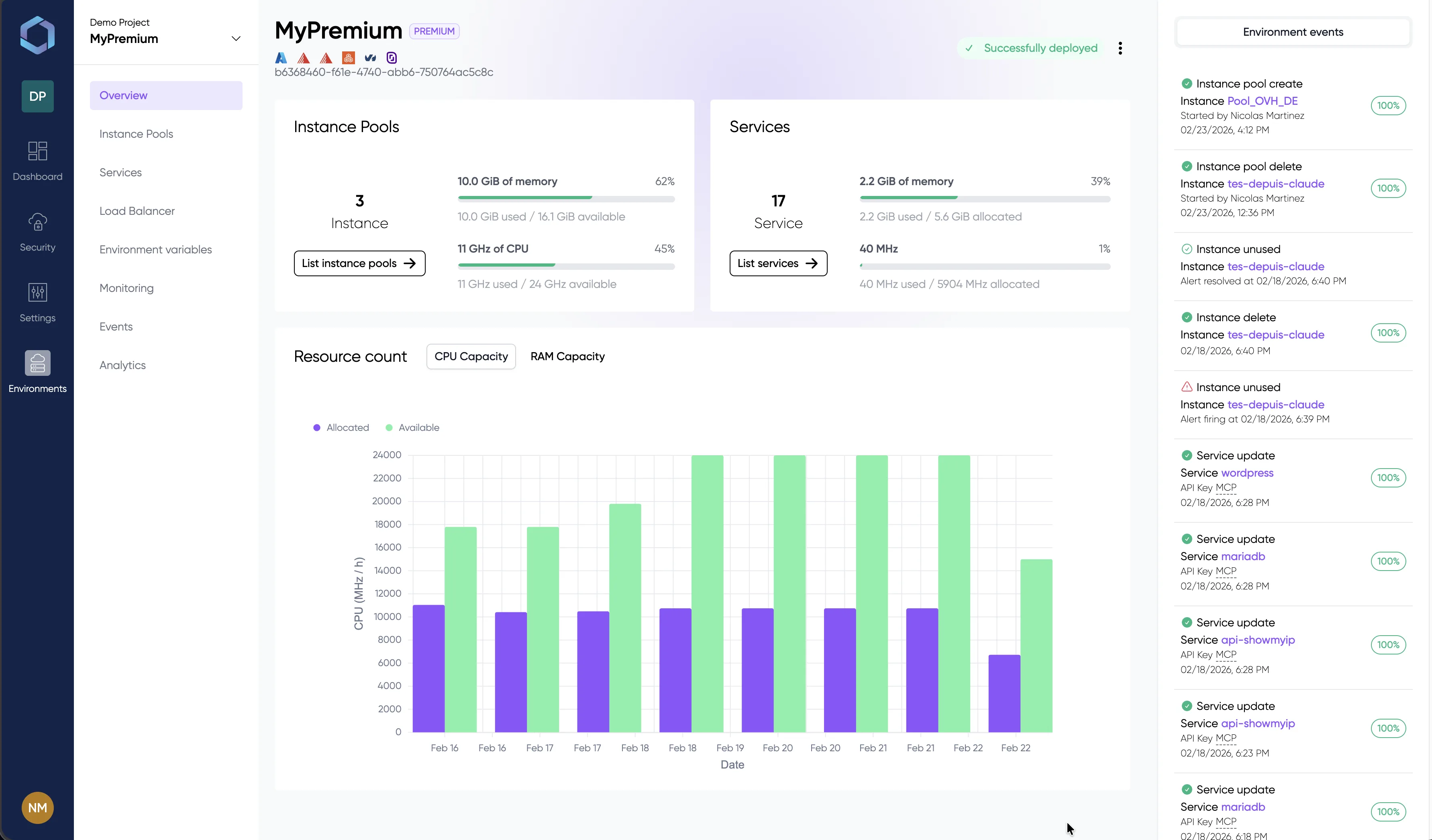

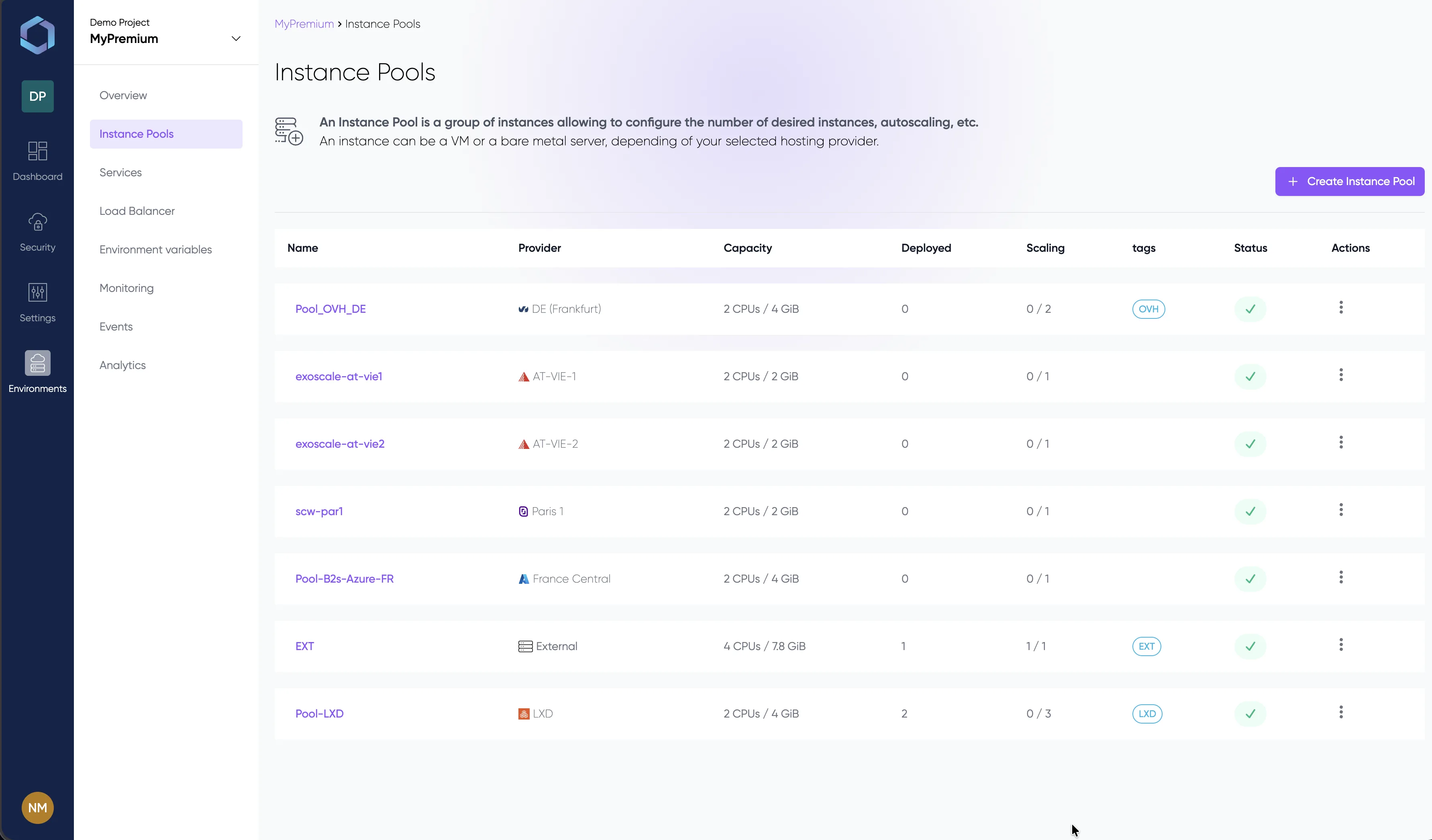

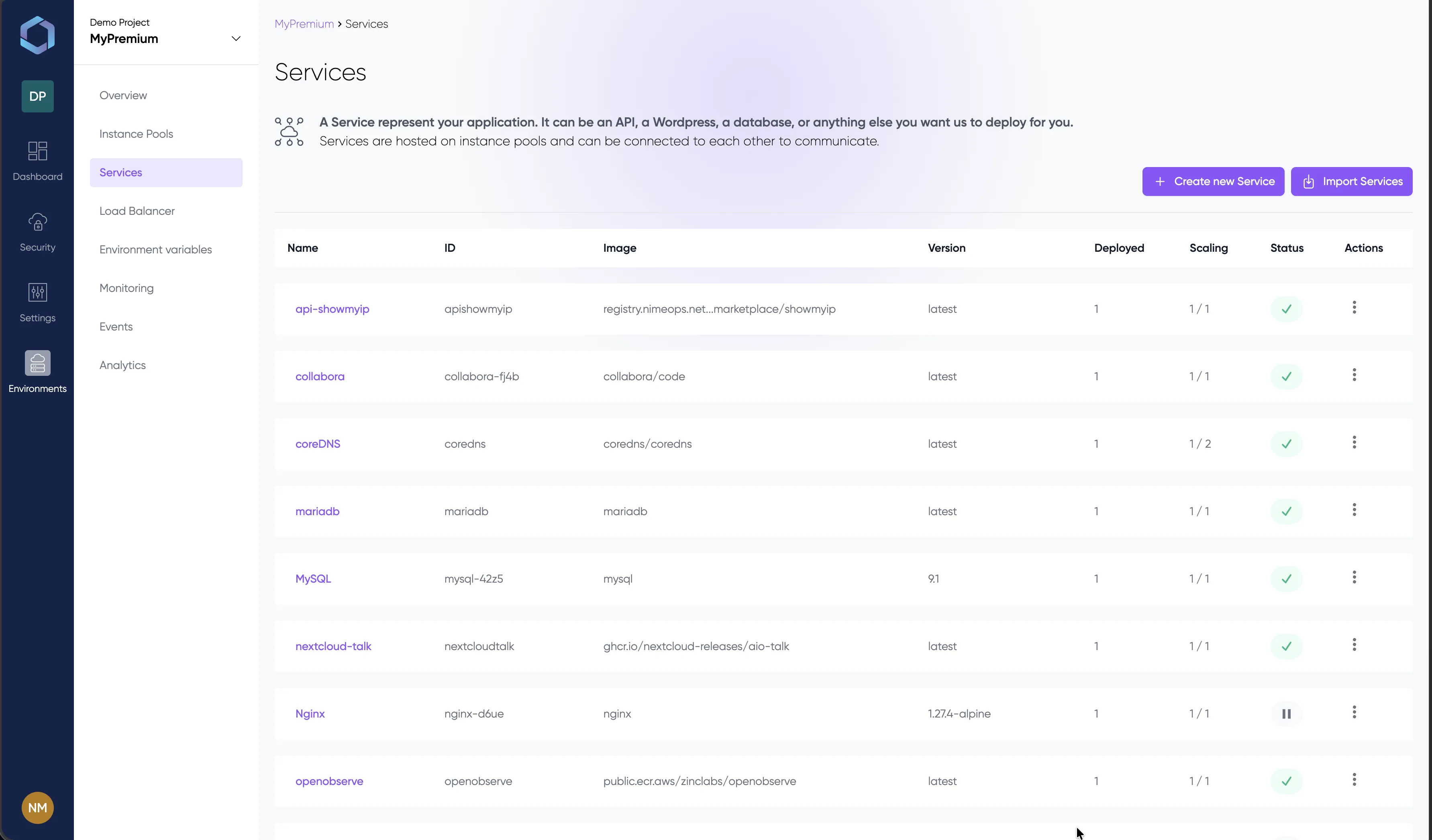

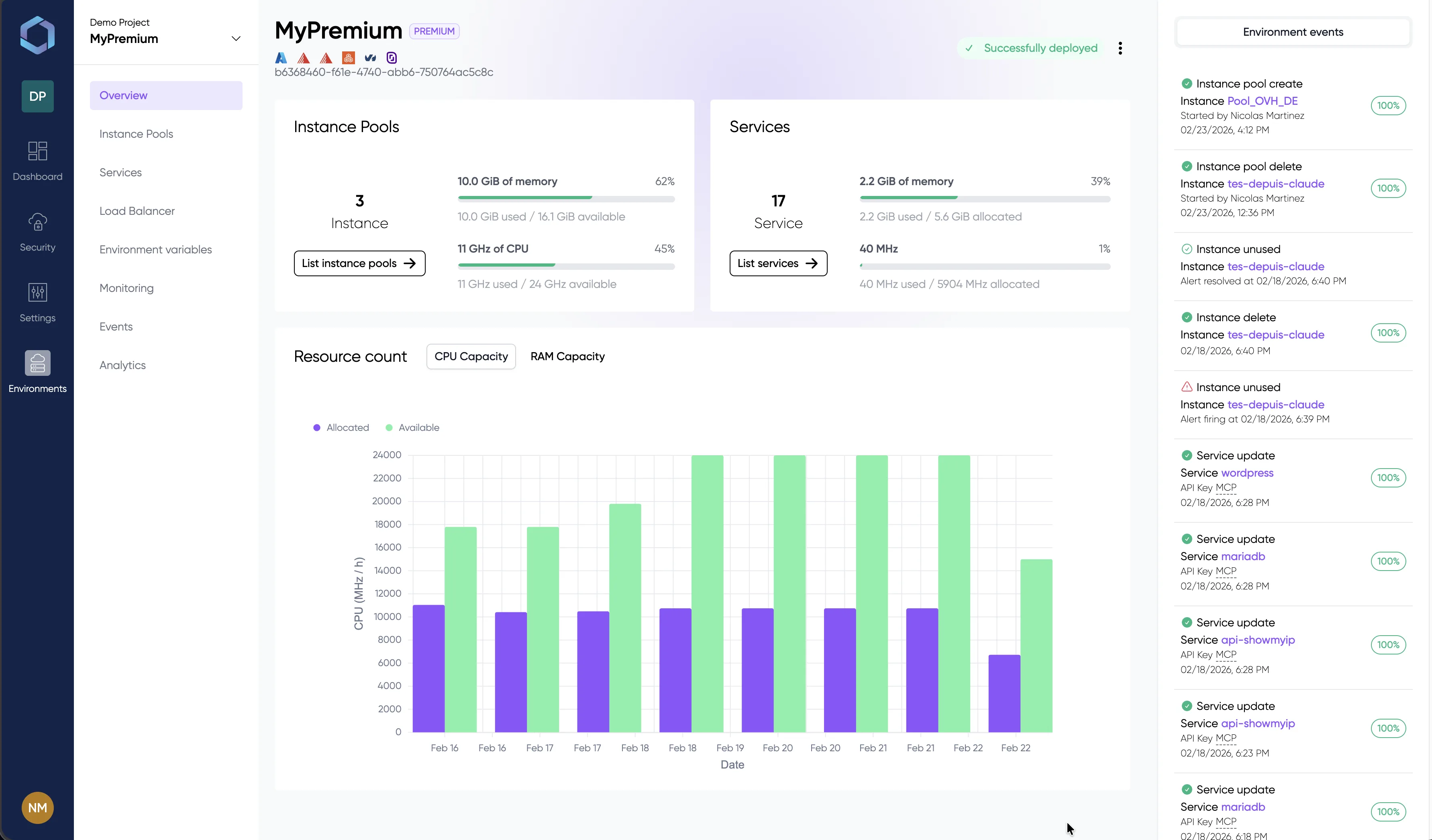

Un aperçu de la console LayerOps

Déployez, supervisez et gérez tous vos conteneurs depuis une seule console.

Explorez la console avec des données de démonstration — aucune inscription requise

Pourquoi les équipes quittent Kubernetes

Trop de choses à gérer

Kubernetes exige de maintenir des control planes, clusters etcd, node pools, plugins CNI, contrôleurs ingress et cert-manager — avant même de déployer votre premier conteneur. LayerOps est entièrement managé : déployez en minutes, pas en semaines.

Les coûts cachés s'accumulent

Au-delà des 73 $/mois de control plane (EKS/GKE/AKS), il faut des ingénieurs DevOps dédiés, une infrastructure de monitoring et des outils tiers. LayerOps inclut tout dans un seul plan — pas de budget ops caché.

Courbe d'apprentissage abrupte

Kubernetes compte des centaines de concepts : Pods, Deployments, StatefulSets, DaemonSets, ConfigMaps, Secrets, RBAC, CRDs, Operators. LayerOps fait abstraction de tout cela — vos développeurs déploient des services, pas de l'infrastructure.

Écosystème fragmenté

Un setup Kubernetes en production nécessite Helm, Terraform, ArgoCD, Prometheus, Grafana, Alertmanager, cert-manager et external-dns — chacun avec sa propre config, ses mises à jour et ses modes de défaillance. LayerOps les remplace tous.

Le multi-cloud est un bricolage

Faire tourner Kubernetes sur AWS, GCP et Azure signifie gérer des clusters séparés, la Federation, ou des outils comme Crossplane. LayerOps déploie sur tous les fournisseurs — y compris OVH, Scaleway et bare-metal — depuis un seul control plane.

Le scaling nécessite des outils en plus

L'autoscaling des pods Kubernetes nécessite Metrics Server et une config HPA par déploiement. L'autoscaling des nœuds nécessite le Cluster Autoscaler, configuré par fournisseur. LayerOps auto-scale services et instances nativement sur tous les clouds.

Comparaison de configuration

Une simple API avec autoscaling, load balancing et SSL. Kubernetes nécessite quatre manifests séparés plus des outils externes. LayerOps gère tout dans une seule définition de service.

Comparaison d'architecture

Une plateforme au lieu de vingt composants

Un cluster Kubernetes en production implique un API server, etcd, un scheduler, un controller manager, kubelet sur chaque nœud, kube-proxy, un plugin CNI, un contrôleur ingress, cert-manager et une stack de monitoring. LayerOps remplace toute cette architecture par une seule plateforme managée — vous définissez vos services, nous gérons le reste.

Multi-Cloud Natif

Déployez partout depuis un seul endroit

Avec Kubernetes, chaque fournisseur cloud signifie un cluster séparé, des outils séparés et une expertise séparée. LayerOps se connecte à AWS, GCP, Azure, OVH, Scaleway et bare-metal via vos propres identifiants cloud (BYOC). Ajoutez un fournisseur, redéployez — les workloads vont là où ils doivent être, sans projet de migration. Découvrir le Bring Your Own Cloud →

Surcharge d'outils

Remplacez toute votre stack DevOps

Un setup Kubernetes en production enchaîne Helm pour le packaging, Terraform pour l'infrastructure, ArgoCD pour le GitOps, Prometheus et Grafana pour le monitoring, Alertmanager pour les alertes, cert-manager pour le SSL, external-dns pour les domaines et Kubecost pour le suivi des coûts. LayerOps fournit toutes ces capacités dans une seule plateforme intégrée.

| Kubernetes + DIY | LayerOps | |

|---|---|---|

| Installation & OpérationsTemps jusqu'au premier déploiement | Jours à semaines | Moins de 10 minutes |

| Infrastructure as Code | Terraform + Helm + YAML | Intégré, en un clic ou YAML |

| Gestion de cluster | Manuelle (mises à jour, patches, etcd) | Entièrement managée |

| Courbe d'apprentissage | Abrupte — nécessite du DevOps dédié | Minimale — conçu pour les développeurs |

| Multi CloudSupport multi-cloud | DIY (Federation / Crossplane) | Natif — tout fournisseur, interface unique |

| Cloud hybride (cloud + bare-metal) | Complexe (Kubelet sur bare-metal) | Natif — combinez toute infrastructure |

| Bring Your Own Cloud (BYOC) | N/A | |

| Changement de fournisseur cloud | Effort de migration majeur | Ajoutez un fournisseur, redéployez |

| DéploiementDéploiement d'images Docker | ||

| Déploiements basés sur Git | ArgoCD / Flux (configuration supplémentaire) | Intégration Git intégrée |

| Auto-scaling (services) | HPA + Metrics Server | Intégré, par service |

| Auto-scaling (instances) | Cluster Autoscaler (par fournisseur) | Intégré, multi-fournisseur |

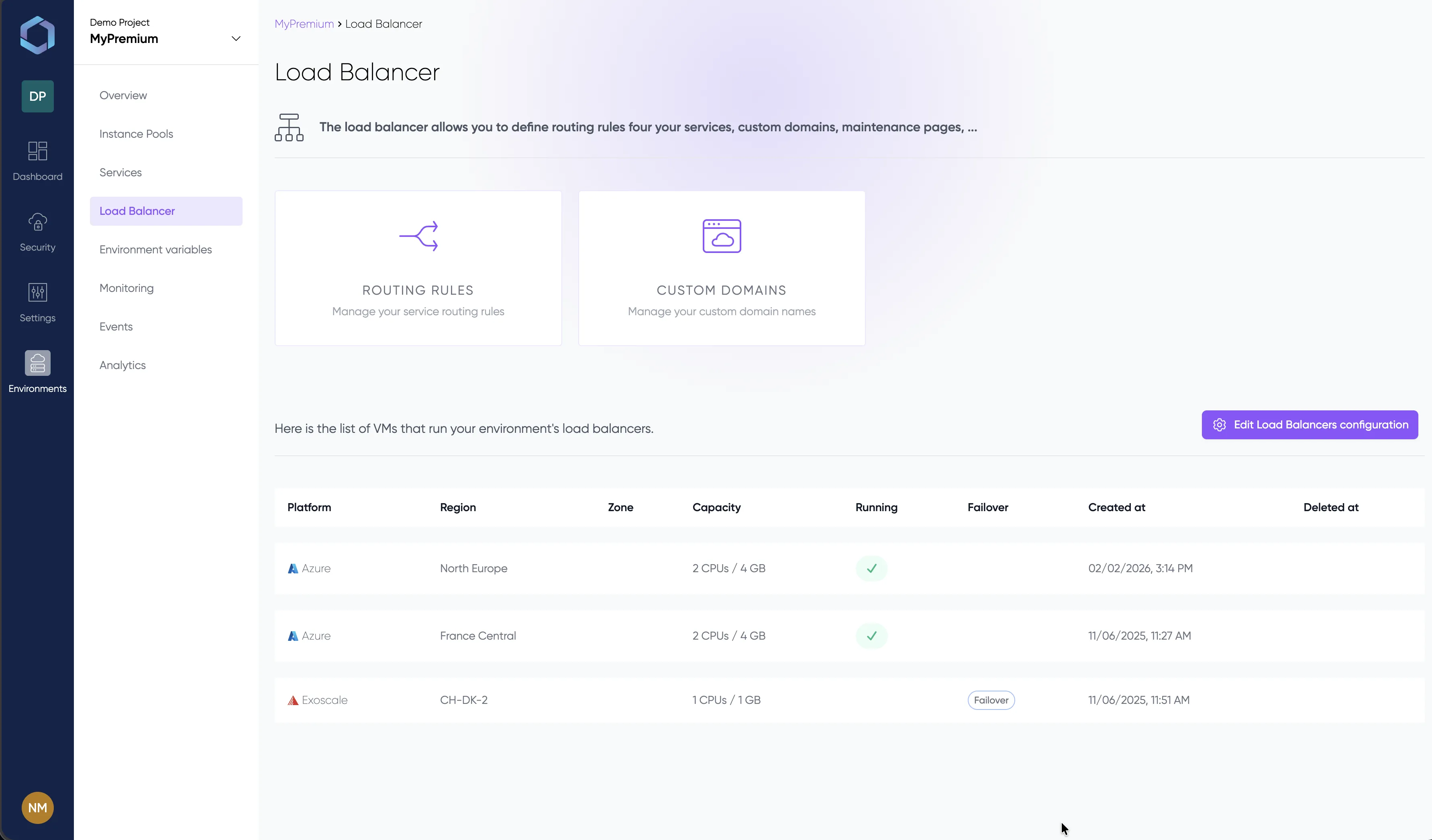

| Load Balancer avec SSL | Ingress + cert-manager | LB HTTP/2 intégré + SSL automatique |

| Domaines personnalisés | DNS manuel + règles Ingress | Mapping de domaine en un clic |

| Monitoring & SécuritéTableaux de bord de monitoring | Prometheus + Grafana (DIY) | Grafana intégré |

| Alertes | Alertmanager (configuration requise) | Alertes personnalisées intégrées |

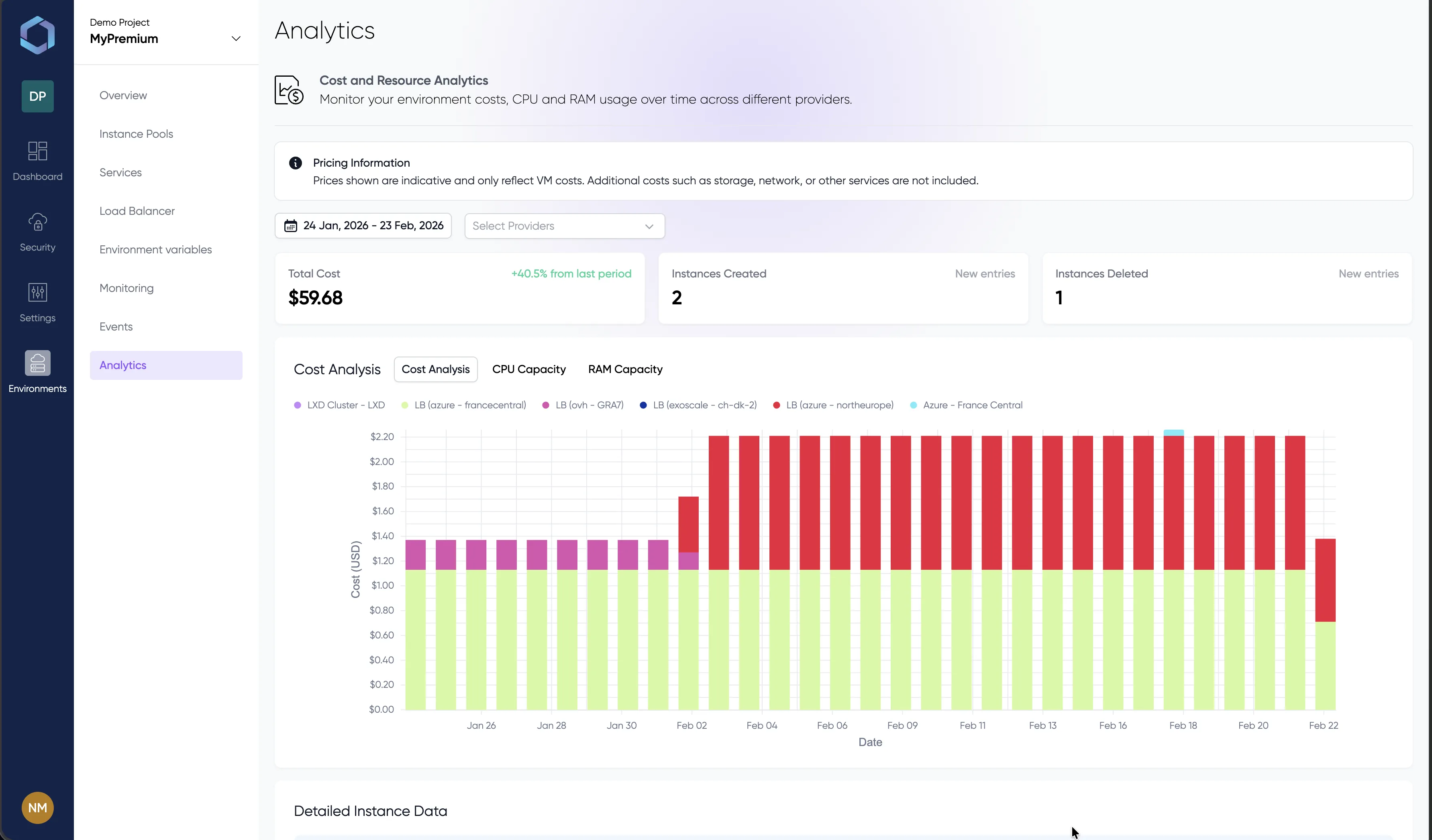

| Analytique des coûts | Kubecost / OpenCost (add-on) | Analytique intégrée par environnement |

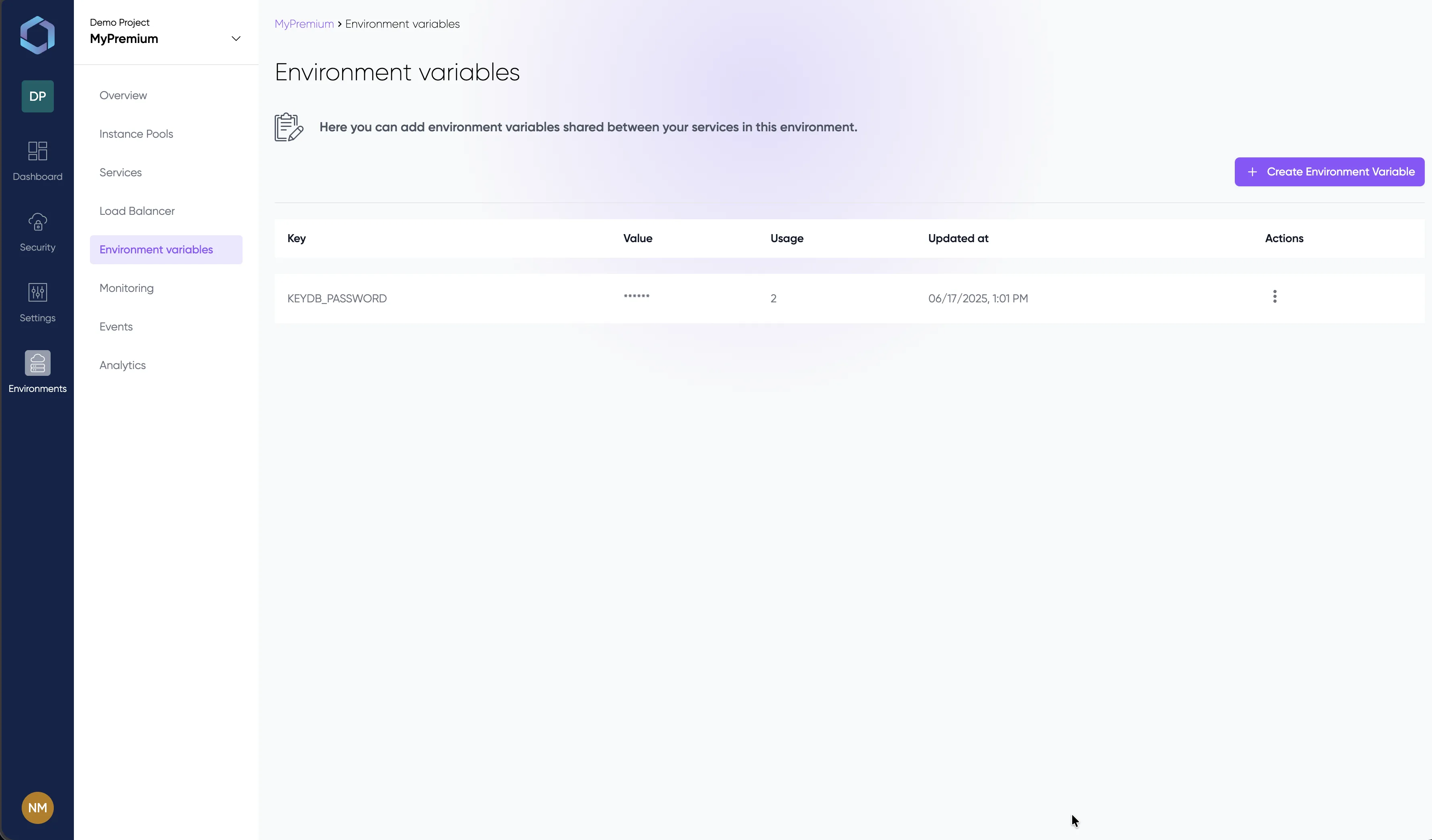

| RBAC | ClusterRole/RoleBinding complexe | RBAC simple au niveau environnement |

| Accès SSH aux services | kubectl exec (accès complet au cluster) | SSH temporaire autorisé |

| Coût opérationnelÉquipe DevOps requise | Oui (1 à 3 ingénieurs minimum) | Non — plateforme managée |

| Coût du control plane | 73 $/mo par cluster (EKS/GKE) | Inclus dans le plan |

| Surcharge d'outils | 10+ outils (Helm, Terraform, ArgoCD…) | Plateforme unique |

Voyez par vous-même

Explorez la console LayerOps sans créer de compte. Parcourez les environnements, services, dashboards de monitoring et configurations de déploiement — avec des données réalistes.

Besoin de Kubernetes malgré tout ?

LayerOps ne remplace pas Kubernetes dans tous les cas d'usage. Si vous avez besoin d'opérateurs personnalisés ou de CRDs, Kubernetes est peut-être le bon choix. Mais pour 90 % des besoins de déploiement de conteneurs, LayerOps vous y amène plus vite — avec moins de coût et de complexité.

Inquiet du lock-in ? LayerOps garantit une réversibilité totale — exportez votre stack vers Docker Compose, Kubernetes ou toute plateforme OCI à tout moment. Zéro dépendance fournisseur par conception.

Vous cherchez à construire une Internal Developer Platform sans la complexité Kubernetes ? Découvrez comment LayerOps permet le Platform Engineering avec des golden paths, du self-service et des guardrails intégrés.

Vous venez aussi d'AWS ? Découvrez comment Daily Solution a réduit sa facture de 72 % en migrant d'AWS Fargate vers LayerOps, ou comparez LayerOps vs AWS Fargate. Vous venez de Heroku ? Voir LayerOps vs Heroku. Vous utilisez Portainer ? Voir LayerOps vs Portainer. Sur Azure ? Voir LayerOps vs Azure ACI.

Besoin de déployer sur votre propre infrastructure ? Découvrez LayerOps On-Premise — auto-hébergé, marque blanche, souverain.

Prêt à simplifier vos déploiements ?

Déployez votre premier service en minutes, pas en jours.