Nous sommes ravis d'annoncer l'ajout du support GPU NVIDIA dans LayerOps ! Cette mise à jour majeure apporte de puissantes capacités GPU à vos services, vous permettant d'exécuter des charges de travail intensives en GPU comme les applications IA/ML et les services Ollama.

Nouvelles fonctionnalités

Support d'instances GPU externes

Vous pouvez désormais rattacher toute machine externe équipée de GPU NVIDIA à votre infrastructure LayerOps. Cette fonctionnalité supporte les systèmes basés sur Ubuntu avec les drivers NVIDIA correctement installés, facilitant l'intégration de votre matériel GPU existant.

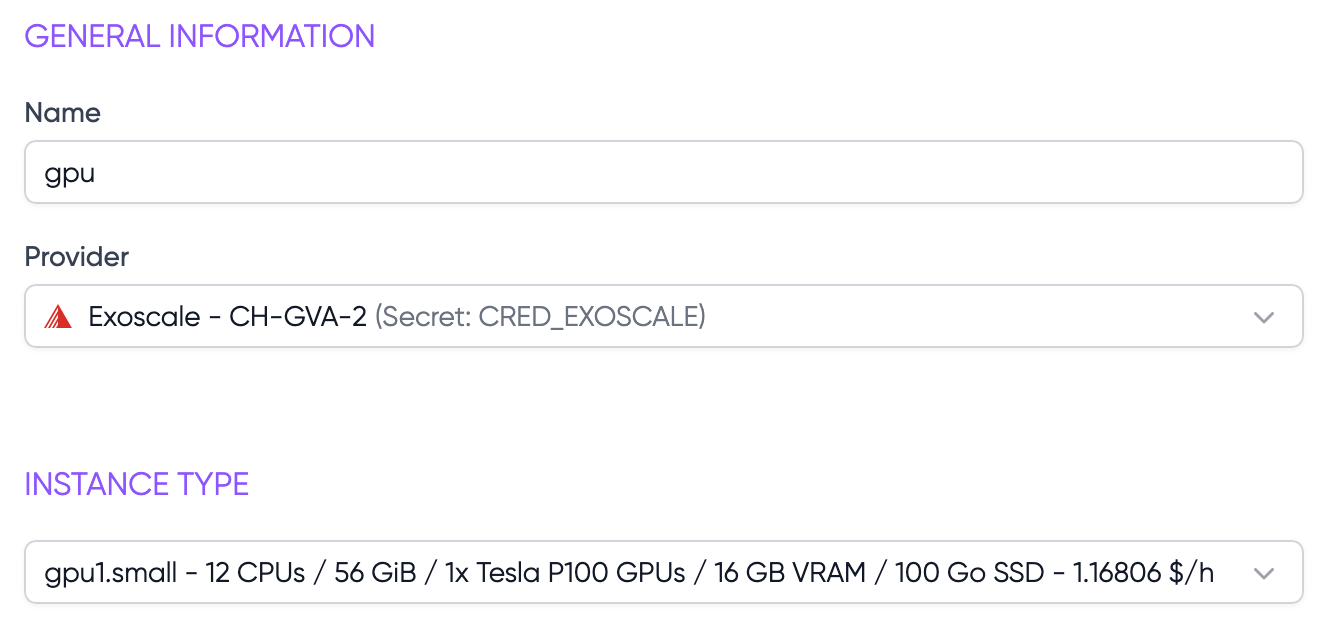

Intégration des fournisseurs cloud compatibles GPU

LayerOps supporte désormais le déploiement d'instances GPU via vos fournisseurs cloud configurés. Cette intégration vous permet de mettre automatiquement à l'échelle vos charges de travail GPU en fonction de la demande, avec le support de différents types d'instances compatibles GPU des principaux fournisseurs cloud.

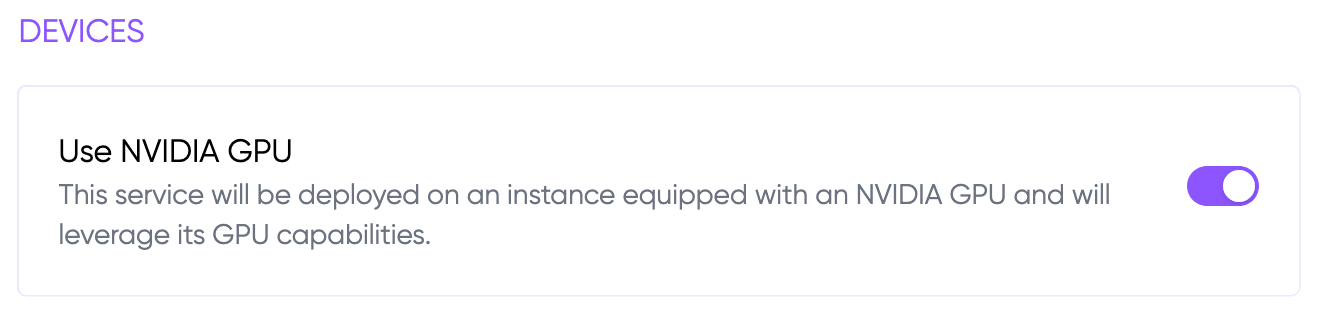

Déploiement de services GPU

La configuration de services pour utiliser les GPU NVIDIA est désormais simple. Activez simplement les capacités GPU dans la section « Devices » de la configuration de votre service, et LayerOps déploiera automatiquement votre service sur les instances compatibles GPU.

Cette intégration transparente garantit que vos charges de travail intensives en GPU s'exécutent sur l'infrastructure appropriée sans aucune configuration supplémentaire.

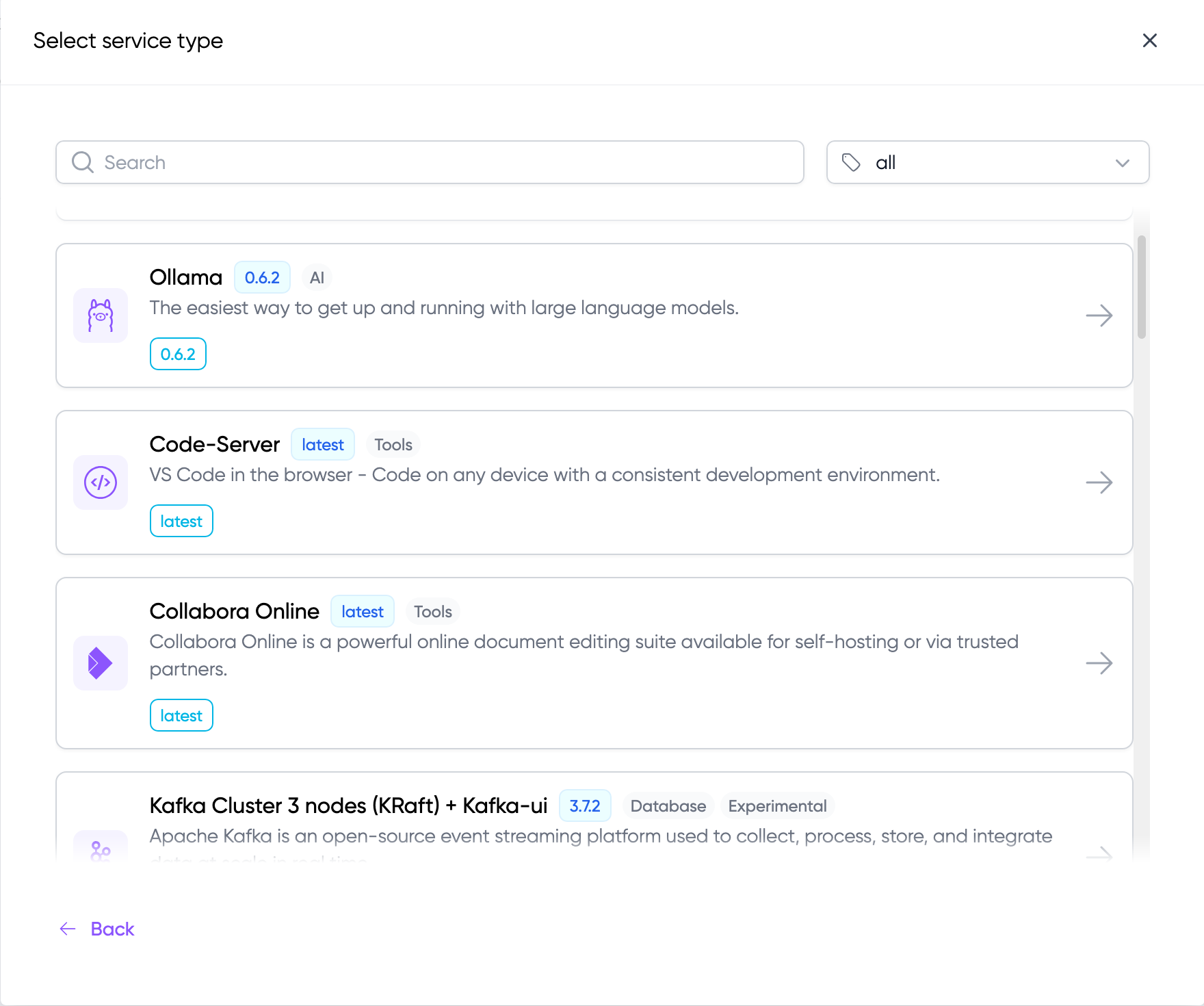

Ollama dans la Marketplace

Ollama est désormais disponible dans la Marketplace LayerOps, permettant un déploiement rapide de grands modèles de langage (LLM). Combiné à notre nouveau support GPU, vous pouvez exécuter efficacement ces modèles sur votre infrastructure GPU.

Fonctionnalités clés :

- Déploiement en un clic d'Ollama avec support GPU

- Allocation automatique des ressources et mise à l'échelle

- Intégration transparente avec le monitoring et les logs LayerOps