Nos complace anunciar la incorporación del soporte para GPU NVIDIA en LayerOps. Esta importante actualización trae potentes capacidades GPU a sus servicios, permitiéndole ejecutar cargas de trabajo intensivas en GPU como aplicaciones de IA/ML y servicios Ollama.

Nuevas Funcionalidades

Soporte de Instancias GPU Externas

Ahora puede conectar cualquier máquina externa equipada con GPUs NVIDIA a su infraestructura LayerOps. Esta funcionalidad soporta sistemas basados en Ubuntu que tengan los drivers NVIDIA correctamente instalados, facilitando la integración de su hardware existente con capacidad GPU.

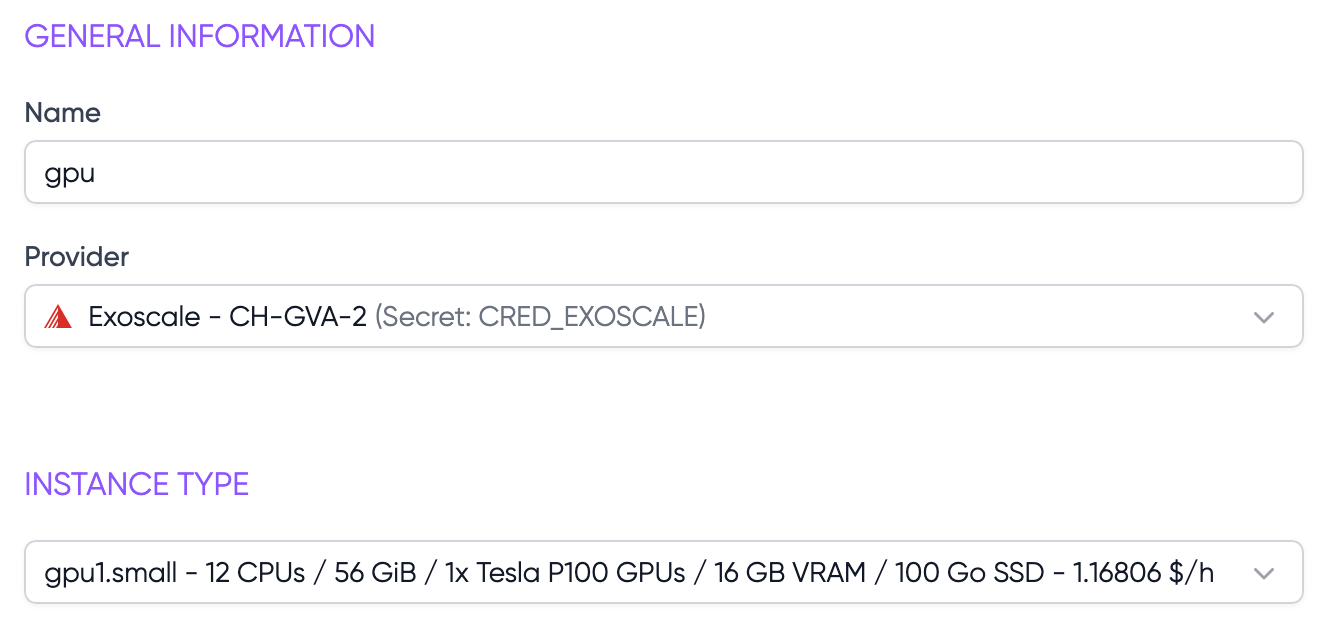

Integración con Proveedores Cloud Compatibles con GPU

LayerOps ahora soporta el despliegue de instancias con GPU a través de sus proveedores cloud configurados. Esta integración le permite escalar automáticamente sus cargas de trabajo GPU según la demanda, con soporte para varios tipos de instancias compatibles con GPU de los principales proveedores cloud.

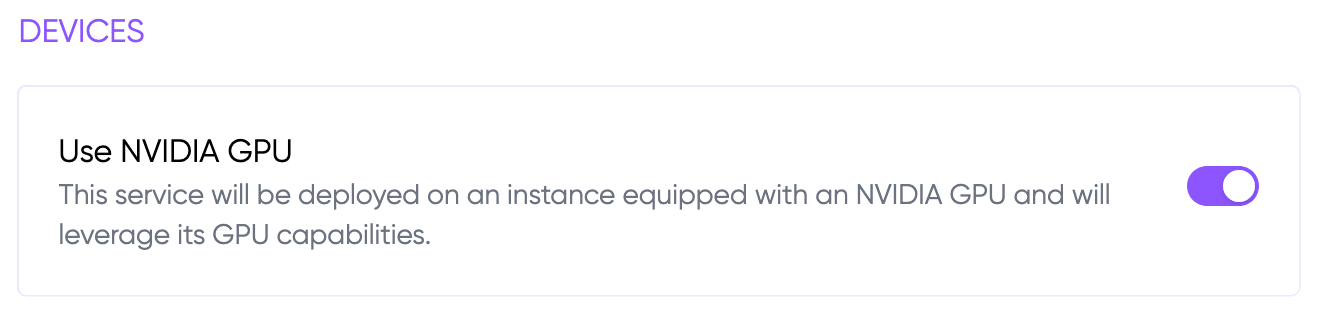

Despliegue de Servicios GPU

Configurar servicios para usar GPUs NVIDIA es ahora sencillo. Simplemente active las capacidades GPU en la sección "Dispositivos" de la configuración de su servicio, y LayerOps desplegará automáticamente su servicio en instancias habilitadas con GPU.

Esta integración fluida asegura que sus cargas de trabajo intensivas en GPU se ejecuten en la infraestructura apropiada sin ninguna configuración adicional.

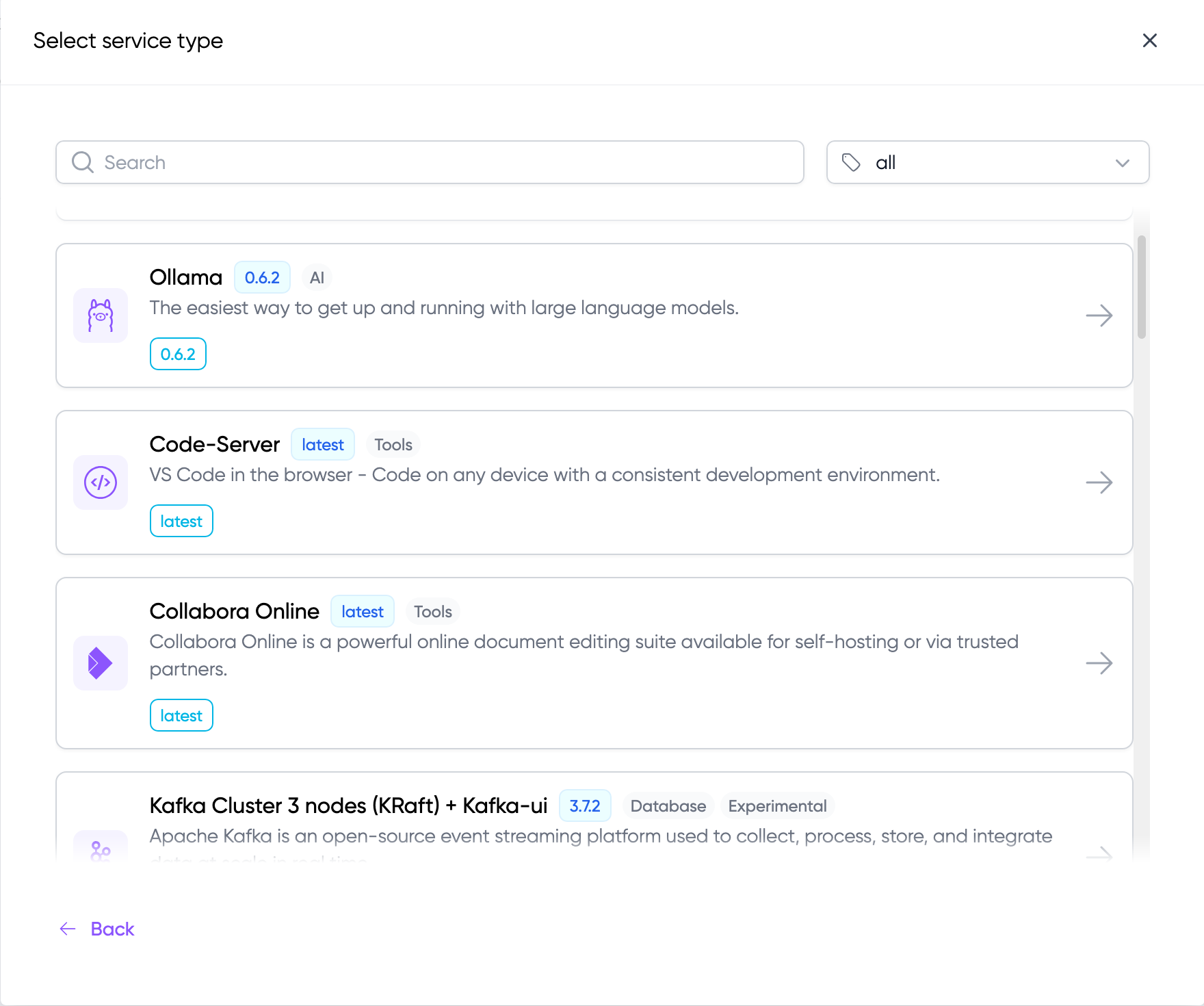

Ollama en el Marketplace

Ollama está ahora disponible en el Marketplace de LayerOps, permitiendo el despliegue rápido de Modelos de Lenguaje de Gran Escala (LLMs). Combinado con nuestro nuevo soporte GPU, puede ejecutar eficientemente estos modelos en su infraestructura habilitada con GPU.

Las funcionalidades clave incluyen:

- Despliegue en un clic de Ollama con soporte GPU

- Asignación y escalado automático de recursos

- Integración perfecta con el monitoring y logging de LayerOps